Si vous vous intéressez à l’IA (Intelligence artificielle), il n’est peut-être pas nécessaire de vous présenter chatGPT. Vous avez même sans doute déjà pu tester “la bête”.

Avant que ce chatbot n’envahisse le Web3, vous pouviez encore l’utiliser librement.

Désormais, il va falloir passer par la case payante.

L’ère de l’IA est en marche, et que ce soit chatGPT, Google Bard ou d’autres, il deviendra évident dans les années à venir de s’adresser à ces outils pour nous faciliter la vie.

Dans le domaine médical, on peut alors imaginer le scénario suivant : vous êtes malade et plutôt que de perdre du temps à essayer de trouver un médecin, de prendre rendez-vous et de vous rendre ensuite à la pharmacie, vous décidez de vous tourner vers chatGPT.

Finalement, la réponse donnée vous semble convaincante et vous parvenez à vous procurer un traitement “alternatif”.

La conclusion de tout ça étant que vous avez gagné du temps grâce à l’IA pour une situation ne nécessitant pas de vous tourner vers un professionnel de santé.

Question : en-dehors de situations complexes, est-ce que chatGPT, et d’autres IA comme Google Bard, vont mettre fin à la médecine traditionnelle ?

Avec un peu de recul, il est vrai que chatGPT dispose de fonctionnalités tout à fait intéressantes.

Elle fait partie de cette forme d’IA capable de générer des informations ciblées à partir d’une requête.

ChatGPT a d’ailleurs été testé pour déterminer la qualité des diagnostics posés sur des cas d’études de patients.

Mais tempérons un peu nos propos.

Tout d’abord, rappelons que chatGPT n’est pas une IA, au sens strict du terme.

Bien qu’on l’apparente souvent à une IA de type “conversationnel“, chatGPT n’est pas une IA et on ne peut pas la considérer comme une IA médicale.

De ce fait, elle ne remplacera pas votre médecin (nous voilà rassurés).

À ce sujet, nous verrons que la solution proposée par Galeon constitue le futur de l’IA médical et plus généralement, de la santé.

La “naissance” de chatGPT, fonctionnement et versions (GPT-3)

ChatGPT n’est pas une IA

En réalité, il s’agit d’une combinaison d’outils issus de l’IA.

ChatGPT est un outil de dialogue informatique (chatbot) créé par l’entreprise Open AI et lancé en Novembre 2022, dans sa version la plus aboutie.

Il utilise l’IA pour trier une multitude de données validées ou non par des personnes physiques. C’est la combinaison de tous ces tests qui permet à chatGPT de vous constituer une réponse in fine.

Il compte notamment sur l’apprentissage supervisé (conclusion à partir de connaissances) et sur l’apprentissage dit de renforcement (à partir d’expériences).

Les différentes versions de chatGPT :

- GPT-1, lancé en 2018, est une version light de l’outil actuel, qui prouve le fonctionnement et le potentiel futur sur un plus large panel de données ;

- GPT-2, lancé en 2019, une version à laquelle on a ajouté plus de paramètres, plus de données ;

- GPT-3, la dernière en date, qui démontre une capacité impressionnante de pouvoir répondre à des requêtes toujours plus complexes, toujours plus rapidement et sous forme de textes structurés.

Pourquoi chatGPT, Google Bard et les autres, ne remplaceront pas votre médecin

Ce qu’il manque à chatGPT en termes d’IA

Comme indiqué précédemment, chatGPT répond à vos questions à partir de son “apprentissage”.

Néanmoins, cela ne prend pas en compte les données sensibles des patients, ou bien même l’aspect émotionnel ou relationnel que peut avoir le médecin avec son patient lorsqu’il réalise une consultation.

? Typiquement, ChatGPT ne vous demandera pas (du moins, pour le moment), votre ressenti douleur sur une échelle de 1 à 10. Or, chaque patient détient sa propre vision de la douleur. Les ressentis ne sont pas les mêmes.

Ce qu’il manquait à Watson, Tay et les autres IA

ChatGPT n’y est pas encore, et pour les autres IA qui ont essayé avant, le bilan est plutôt décevant.

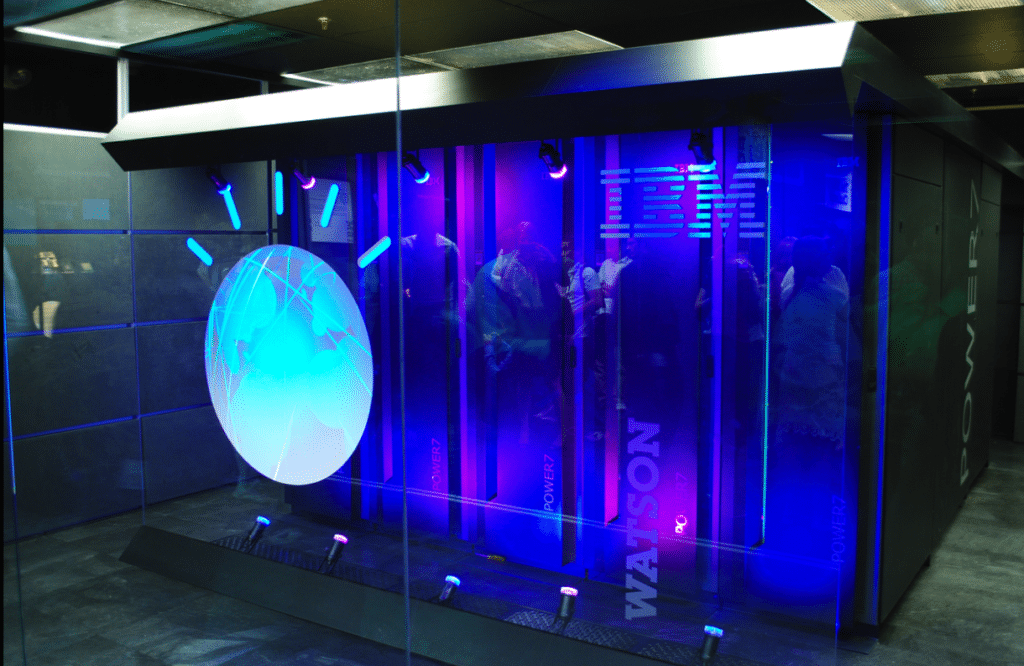

Le cas d’IBM Watson

On pense notamment au programme d’IA IBM Watson, conçu par l’entreprise IBM à la fin des années 90.

Développé initialement pour servir d’outil conversationnel, le programme ne parvient pas à réussir plusieurs tests, dont celui de Turing. On lui trouve alors une utilité potentielle dans le milieu médical.

Malheureusement, on a vu très vite les limites de cette IA médicale, les données étant limitées au cercle d’études et de rapports de professionnels du milieu.

Or, un certain nombre de ces études publiées manque d’objectivité et de contrôles.

Ce qui impliquera par la suite, la remise en question des réponses données par Watson.

Le cas Tay

Il y a eu aussi l’histoire de Tay, développé par Microsoft sur le réseau Twitter (2016).

Sans entrer dans les détails, on s’est très vite rendu compte des limites de ce programme considérant toutes les dérives qui ont pu se produire.

Avec très peu de contrôle, les réponses du chatbot se sont retournées contre lui, lui infligeant une fermeture de rideau.

En conclusion de toutes ces expériences, on se rend compte de l’importance pour ce type d’IA d’être fournie en données de qualité, à la source (raw structured data).

Et on vous le donne en mille, c’est exactement la vision adoptée par Galeon en termes l’IA médicale.

Galeon, l’IA de référence en matière médicale

Galeon est sans aucun doute, la référence pour les années à venir en matière d’IA médicale.

Actuellement, les professionnels de santé peuvent déjà compter sur Galeon afin d’optimiser leur temps de travail, leurs consultations ou encore la constitution des dossiers patients.

Galeon, c’est aussi de l’IA médicale qui permettra de générer des réponses très précises grâce à une base de données structurée et du blockchain swarm learning (forme de machine learning).

Dans cette dynamique, il est certain que Galeon viendra appuyer les décisions des professionnels de santé.

Là où chatGPT ou toute autre forme d’IA semblable ne se limitera qu’à de simples pistes de réflexions fondées sur des données plus ou moins bancales et en dehors du champ des données patient, beaucoup trop sensibles.

Or, sans cela, impossible d’envisager une approche sérieuse d’une quelconque assistance médicale de la part de l’IA.

0 comments